日高市と入間市でも出没の報あり。狭山は広大な山林を背負っている地形ではないが、隣の市で出たとなると気になる。

日高市大字清流はいわゆる日和田山のあたり。

入間市仏子は加治丘陵に近いので、そこから移動してきたのかもしれない。どちらもうちから10km圏内。

行動範囲

GPS首輪を使った調査では、1頭のクマの行動範囲は山間部のどんぐりが豊作の年には2-3km四方くらいだが、凶作の年にはクリなどを求めて標高の低い方へ15kmほども移動するとのこと。

「ツキノワグマ大量出没の原因を探り、出没を予測する」森林総合研究所, 2011

「ツキノワグマ大量出没の原因を探り、出没を予測する」森林総合研究所, 2011

藪などで見通しの悪い河川敷、河岸段丘の雑木林などがクマの移動経路になる(ので刈払いをした方が良い)という話がある。どちらも我が市にはあるな。

クマが柿や栗の実、どんぐりを好むことは知られているが、意外なところでは「油」が好きらしい。油が揮発する臭いが針葉樹の樹脂に似ているので、燃料やペンキなども好むという。うちの庭にも使いかけの塗料が放置してある。水性塗料ではあるが、始末しておくか。

https://www.env.go.jp/nature/choju/docs/docs5-4a/

熊害とどんぐりの豊凶

ニュースなどでは連日クマの出没や人的被害の報道があり、今年は山地のどんぐりが不作だから…というようなことも言われているが、一次資料を見ると全国的に不作の傾向があるかどうかは何とも言えない。山地を持つ各県では山の堅果類の豊凶を9月くらいに速報しているが、富山・新潟は凶作、長野は例年並み、栃木はおおむね良好と言っている。また、一つの県内でも場所によって豊凶にはかなりばらつきがある。これらのデータを見る限り、今年の全国的傾向としてどんぐりが凶作かどうかは、簡単には結論できない。そういうコメントの類はおおむね眉唾なのではと思われる。

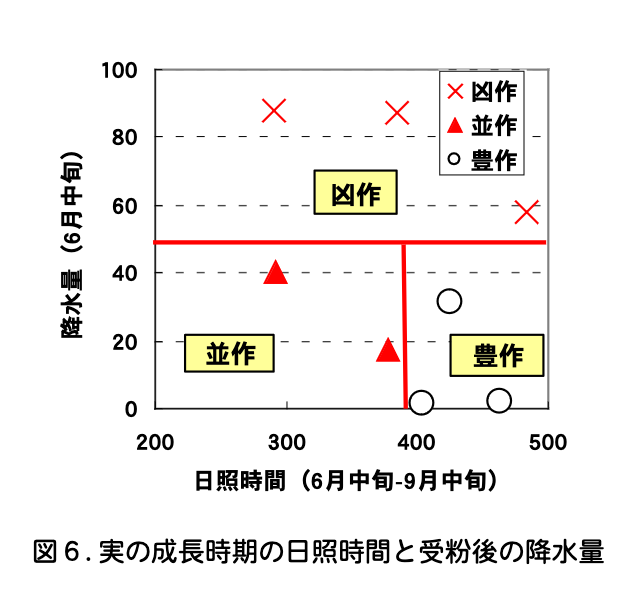

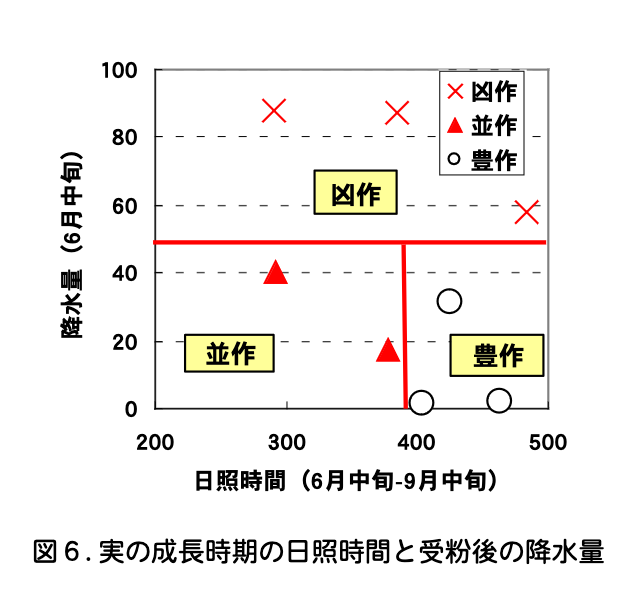

今年は猛暑の記憶が強いが、暑い年はどんぐりが凶作になるのかというと、そういうことでもないらしい。大まかには、日照よりも降水量の方が強く効き、梅雨時の降水量が少なく夏の日照が多い年に豊作になるという傾向があるようだが、強い相関があるとまでは言えそうもない。

「どんぐりの豊作は予測できる?」渡辺展之, 『調査館通信』35号, さっぽろ自然調査館, 2010

「どんぐりの豊作は予測できる?」渡辺展之, 『調査館通信』35号, さっぽろ自然調査館, 2010

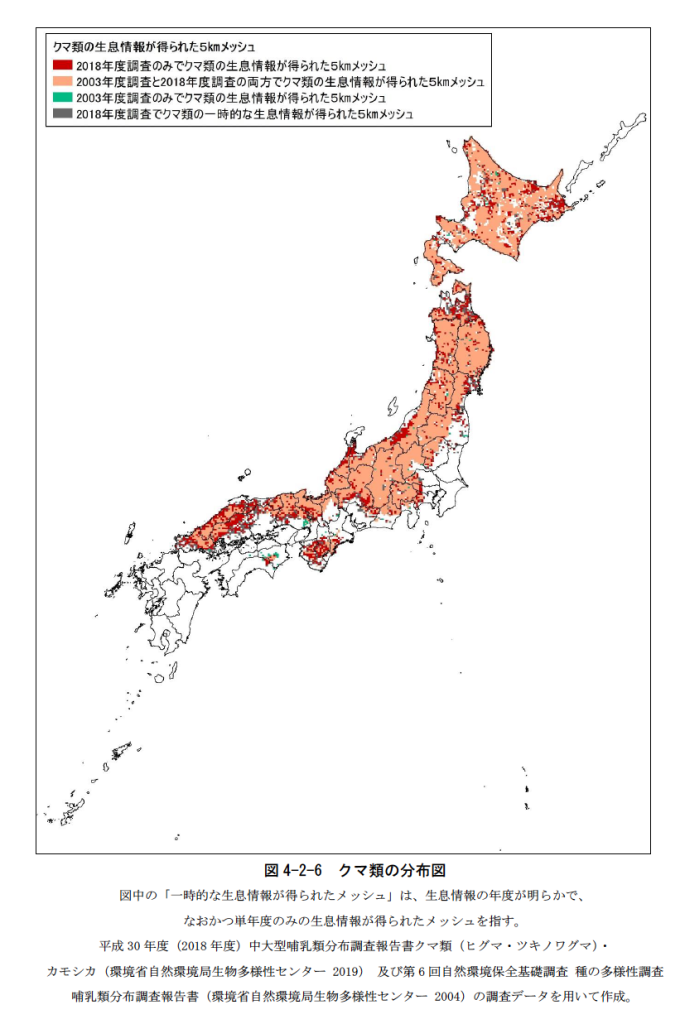

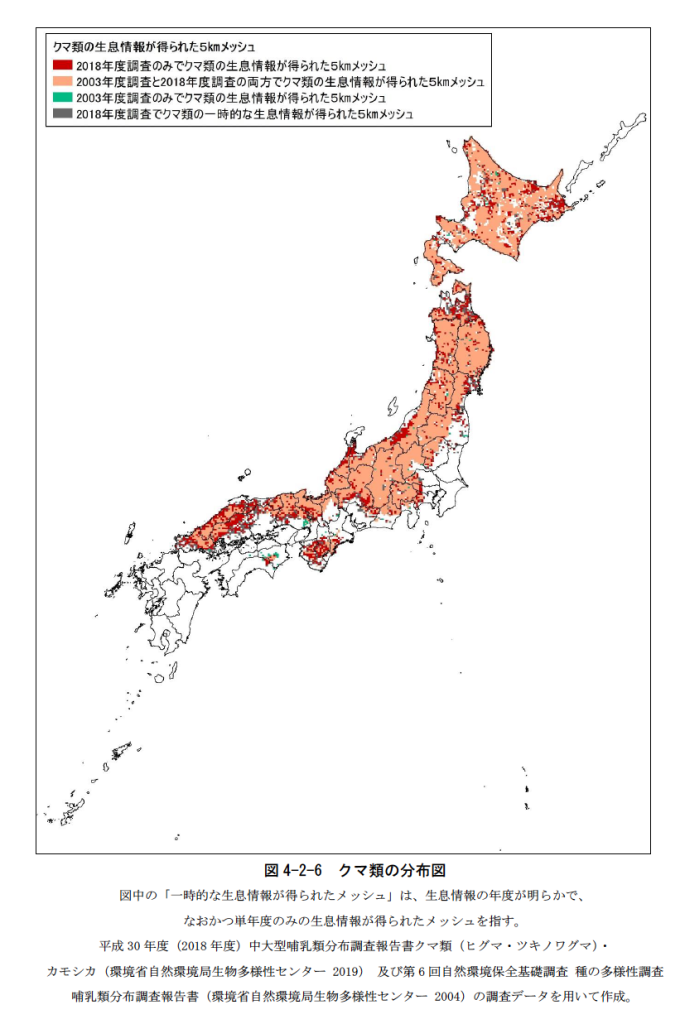

分布

山地ならどこにでもいるわけではなく、九州や四国西部にはいない。伊豆半島や千葉県にもいない。伊豆や南房総にはそれなりに深い森林があるので意外。ただし、オレンジ→赤の範囲から分かる通り、平野部に向かって分布は着実に拡大している。

クマ類出没対応マニュアル -改定版- || 野生鳥獣の保護及び管理[環境省]

クマ類出没対応マニュアル -改定版- || 野生鳥獣の保護及び管理[環境省]